GPT-4是最先进和备受期待的AI模型之一,是GPT的第四个版本。与GPT-2相比,GPT-3的性能有了显著提高。如果GPT-4能够将AI模型提升到一个新的水平,那么它就像是能力的一次飞跃。而最好的事情是,GPT-4几乎已经准备好了。我们可能在接下来的几个月里就能体验GPT-4,它应该会在2023年初准备好。

由于OpenAI是GPT-4背后的公司,因此关于GPT-4的具体规格还不清楚,因为OpenAI没有披露有关该模型的太多信息。

在本文中,我想总结一下我们到目前为止对GPT-4所知道的事实、传言和关于下一代AI模型的普遍期望。

什么是GPT?

在深入了解细节之前,有必要描述一下GPT是什么。GPT(Generative Pre-trained Transformer)是一个文本生成AI模型,它是在互联网上可用的数据上训练的。GPT旨在生成类似于人类的文本。

GPT模型的应用是无穷无尽的。它可以用于问答、文本摘要、翻译、分类、代码生成等。有些人认为,在未来,GPT或类似的AI模型可以取代谷歌。

GPT为企业主提供了很多机会。可以对模型进行特定数据的微调,以在特定领域获得卓越的结果(这个过程称为迁移学习)。初创公司和企业公司将使用GPT作为创建产品的基础,这将使他们免于训练自己的AI模型。

GPT-4模型的大小是多少?它会有多少个参数?

参数是AI模型内部的配置变量,其值可以从提供的数据中提取。AI模型在进行预测时使用参数。

一个AI模型拥有的参数数量是一个常用的性能指标。缩放假设指出,随着我们适当地扩大模型大小、数据和计算能力,语言建模性能会平稳而可预测地提高。这就是为什么许多AI模型的创造者都专注于增加其模型拥有的参数数量。

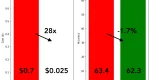

自从2018年GPT-1发布以来,OpenAI一直遵循“越大越好”的策略。GPT-1有1.17亿个参数,GPT-2有12亿个参数,而GPT-3将数字进一步提高到了1750亿个参数。这意味着GPT-3模型的参数比GPT-2多100倍。GPT-3是一个非常大的模型大小,有1750亿个参数。

在2021年8月接受《连线》(Wired)采访时,Cerebras的创始人兼CEO Andrew Feldman提到,GPT-4将拥有约100万亿个参数。这似乎意味着GPT-4将比GPT-3强大100倍。

不足为奇,这让人们感到非常兴奋。

实际上,模型大小与它产生的结果的质量没有直接关系。参数的数量不一定与AI模型的性能相关。这只是影响模型性能的一个因素。现在,我们有比GPT-3更大的AI模型,但它们在性能方面并不是最好的。例如,由Nvidia和微软构建的Megatron-Turing NLG已经超过了5000亿个参数,是目前最大的模型。但是,尽管MT-NLG不是性能最佳的模型,但更小的模型可以达到更高的性能水平。

此外,模型越大,调整模型就越昂贵。GPT3已经很难且昂贵地进行了训练,但如果将模型的大小增加100倍,那么从计算能力和模型所需的训练数据方面来看,它将变得极其昂贵。OpenAI将在GPT-4中使用1万亿参数的可能性较低,因为仅仅增加训练参数的数量并不会引起任何剧烈的改进,如果训练数据也没有相应增加的话。大型模型通常是未经优化的(以Megatron-Turing NLG为例)。训练模型的成本非常高,公司常常不得不在AI模型的准确性和训练成本之间进行权衡。例如,GPT-3只被训练了一次,尽管AI模型存在错误,但由于成本过高,OpenAI无法再次训练模型。

这意味着OpenAI很可能开始避免“越大越好”的方法,专注于模型本身的质量。最有可能的是,GPT-4的大小将大致与GPT-3相同。

更有趣的是,OpenAI很可能将重点转向其他影响模型性能的方面,如算法和对齐。GPT-4可能是第一个以稀疏性为核心的大型AI模型。稀疏模型使用条件计算来降低计算成本 - AI模型中并不是所有的神经元在任何给定时间都处于活动状态。该模型可以轻松扩展到超过一万亿个参数而不会产生高昂的计算成本。稀疏模型也更好地理解上下文 - 它们可以基于用户提供的内容保留更多的“下一个单词/句子”选择。因此,稀疏模型比它们的前辈更类似于实际的人类思维。

GPT-4是文本模型还是多模型?

AI模型可以是文本模型或多模型。文本模型接受文本作为输入,并生成文本作为输出。GPT-3是一个文本模型。多模型接受文本、音频、图像甚至视频输入。它使用户能够使用AI生成音频视觉内容。多模式是AI的未来,因为我们生活的世界是多模式的。DALL-E是一个多模型。

使用DALL-E生成文本提示的可视化效果。

好的多模型比好的仅语言模型更难建立,因为多模型应该能够将文本和视觉信息组合成一个单一的表示。就我所见,OpenAI正试图找到仅语言模型的极限,并且他们很可能会继续朝着这个方向发展GPT-4,而不是试图创建一个强大的多模型。因此,GPT-4很可能是一个仅文本模型。

GPT-4是否不再依赖于好的提示?

任何有使用GPT-3经验的人都知道好的提示有多么重要。当你努力寻找正确的提示时,最终结果将不够好。许多人对GPT-4的期望是,这个模型将不再依赖于好的提示,让用户更自由地制定他们想要的意图,并更有信心地认为系统会理解他们。

OpenAI追求的目标是使语言模型遵循人类意图。 GPT-4的几率更高比GPT-3更加对齐。在发布ChatGPT之前,该公司投资了InstructGPT,这是一个基于人类反馈训练的GPT-3模型,以遵循指令。InstructGPT是在大量的指令文本数据集上进行训练的,包括食谱指令、操作指南和其他类型的书面指令。InstructGPT的目标是生成清晰、简洁且易于遵循的自然语言文本。

GPT-4会改变世界吗?

GPT-4会像Covid一样影响社会吗?

GPT-4肯定会影响人们的工作方式,但这并不意味着影响会与Covid相比(至少在最初的几年内)。最有可能的是,GPT-4将提高生产力,使人们能够比没有使用AI更快地完成工作。同时,我们仅仅是在采用AI工具的开始阶段,AI工具应该赢得人们的信任,只有在这之后,人们才会开始在日常工作中使用它们。

_个人经验。_自从ChatGPT(一种基于GPT-3.5语言模型的先进聊天机器人)公开以来,我一直在工作中使用它,我必须说它提供了许多好处。然而,该工具生成的输出通常需要验证和更正。例如,该工具可能会编造事情或使用不正确的引用。有时使用ChatGPT创建文本需要的时间比我从头开始写它还要长。该模型尚未达到真实经验的细微差别和复杂性的类人理解。

使用ChatGPT解释“复杂”和“复杂”的区别。

即使GPT-4在性能方面取得了飞跃,系统的采用率在第一年内也不会引起注意。人们需要几年时间才能接受这种变化。而且在开始时,我们可能会在许多领域发现人类表现得明显更好。

参考文献:Algorithmic Bridge(Alberto Romero),Reddit(OpenAI线程),Wired(Andrew Feldman采访),AI Breakfast,Greylock(Sam Altman采访)。本文最初发表在 babich.biz 上。

译自:https://uxplanet.org/gpt-4-facts-rumors-and-expectations-about-next-gen-ai-model-52a4ddcd662a

评论(0)