作者搭载扩散模型

我们刚刚见证了史无前例的事情。

机器首次能够像人类一样识别事物,甚至更好,Meta引领了人工智能看和感知的范式转变。

它的新基础模型,Segment Anything Model(SAM),令人惊叹地证明了人工智能正在以越来越快的速度发展,这可能会让人们感到害怕。

在这种情况下,SAM可以代表着未来的关键技术,例如自动驾驶或物理安全,可能在我们生活的多个方面带来飞跃性的改进。

而且最好的是,你今天就可以亲自尝试它。

但这也是一种技术,如果落入错误的手中,特别是错误的政府手中,可能会成为控制社会的终极武器。

一种计算机视觉的GPT

像ChatGPT这样的工具,其背后的基础模型GPT-4可能是你正在阅读本文的原因。

但是,生成式人工智能技术对我们的工作有着明显的直接影响,而像SAM这样的模型则可能对我们的生活方式产生深远的影响。

这是因为SAM在人工智能领域带来了前所未有的东西。

第一个图像分割的基础模型。

但这到底意味着什么呢?

发生了范式转变

一年多以前,人工智能被认为是富人的游戏。

要在特定情况下使用人工智能,你必须收集大量数据,选择正确的模型,承担不可思议的计算成本,然后希望它能够工作。

此外,如果你发现了一种新的使用人工智能的机会,你必须再次重复这个过程。

因此,人工智能对于普通公司来说是一个禁区,对于任何个人使用来说都是禁止的。这是富人的游乐场。

但是,这一切都因为基础模型而改变了。

基础模型是你在这里的原因

OpenAI的GPT是一种基础模型。

但是,即使你听说过很多关于它的事情,很少有人了解它是如何产生的...这可能会让你感到惊讶。

像GPT这样的模型被提供了大量的非结构化文本数据,其特定的训练目标是预测序列中的下一个“东西”。

对于ChatGPT来说,这是序列中的下一个单词,对于DALL-e来说,这是图像中的下一个像素(GPT被改进以适应这个特定的情况)。

你给它们一个输入序列,它们就会结束它,不管是用另一个文本还是一个图像。就是这么简单。

通过这样的方式,GPT变成了一个大型语言模型。

但是,GPT令人惊讶的一点是,它在许多应用中表现得很好。或者说,AI术语中的“泛化能力”很强。

这意味着基础模型可以轻松地针对更具体的领域使用情况进行定制,并在不必为每种使用情况创建特定模型的情况下实现最先进的结果。

为了理解这一点有多么强大,这一个概念就是OpenAI将成为下一个万亿美元公司的原因。

但是,为什么这个概念如此基础呢?

基础模型,一个万亿美元的想法

如前所述,ChatGPT和Dall-e是相同基础模型GPT的特定领域应用程序。

因此,我们将GPT定义为基础模型,这个模型非常擅长许多事情,可以轻松地在多个领域中部署。

这一影响已经如此强烈,以至于从媒体的报道来看,似乎人工智能可以归结为ChatGPT、DALL-E等几个应用程序。

但这与事实相去甚远。

人工智能还有更多的应用,而世界即将因为SAM而尝到它的滋味,这是Meta的“计算机视觉的GPT”。

但你不必相信我,你即将亲眼见到它,并尝试它。

将我想要的东西分段

有了SAM,Meta真正提高了赌注。

但是,SAM到底是做什么的?

简单。

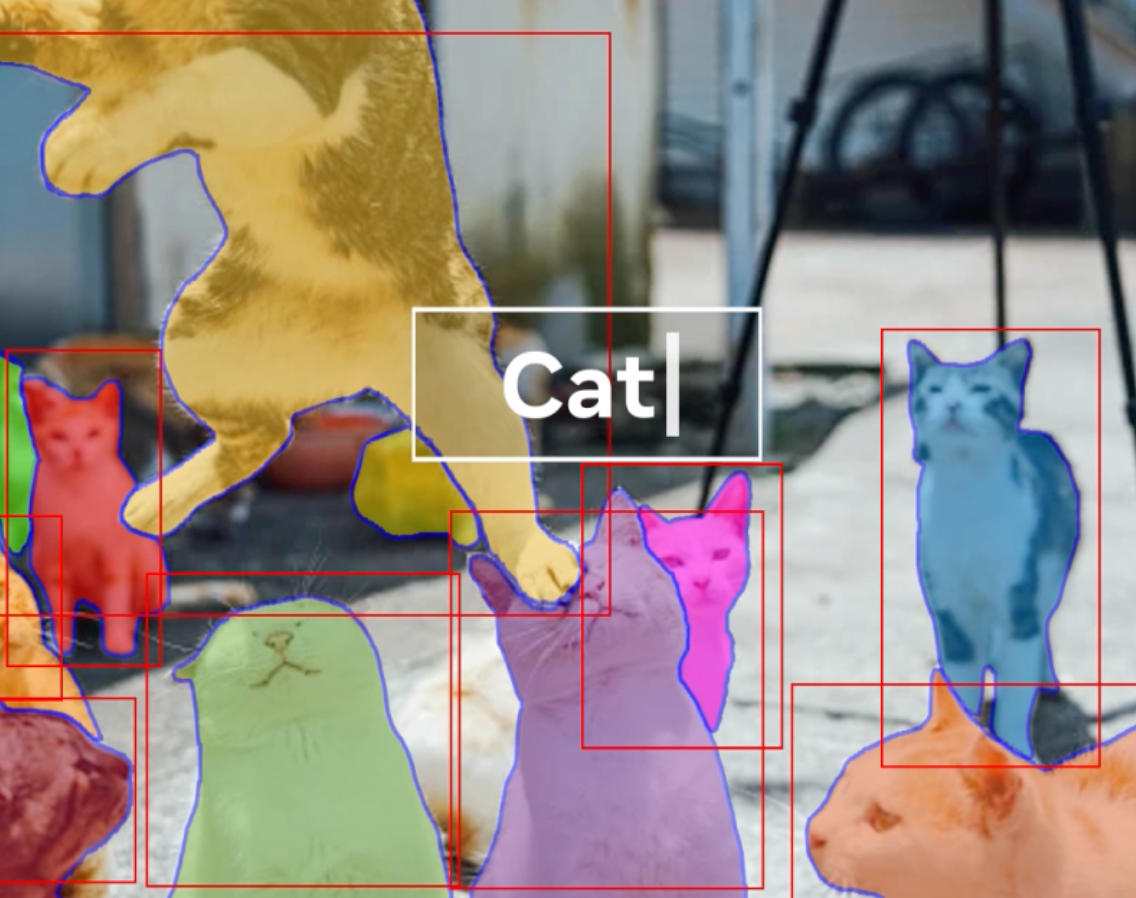

给定一张图片,它能够以惊人的准确度检测出其中的100个物体。

难以置信吗?看下面:

来源:Meta

正如你亲眼所见,该模型甚至可以识别最复杂的细节,包括水果、衣服,以及令人害怕的面孔。

这种惊人的性能可以追溯到一个常见的嫌疑犯——Transformers,人工智能的“北极星”。

再次提到Transformers...太棒了!

尽管它们用于非常不同的用例,但底层架构是相同的——Transformer。

Transformers使用注意力的概念,简单来说,就是在给定输入(在SAM的情况下,既有图像又有文本)的情况下,该架构会在它们之间找到模式,从而能够理解它正在阅读和看到的内容。

在SAM的情况下,Transformers用于执行以下目标:

就像GPT被训练来预测序列中的下一个单词一样,SAM被训练来检测特定点或区域中的对象。

特别是,该模型的工作如下:

- Vision Transformer(ViT)生成图像的嵌入(以向量形式表示的图像表示)。这使模型能够提取图像的上下文信息。

然后,一个提示编码器获取提示的嵌入。

最后,一个遮罩解码器将这两个嵌入的信息结合起来,并将其映射到输出中,即代表图像中检测到的对象的遮罩。

SAM的显著特点是,这个过程可以很好地处理你提供的任何图像。与GPT一样,SAM能够在几乎所有自然语言应用中表现出色,它在所有你能想到的图像分割任务中都表现出色。

特别是,SAM能够在多种情况下检测对象:

- 用光标点击对象

- 画框以检测其中的任何对象

- 画出密集的遮罩以提供更详细的目标

- 甚至是自由文本,例如在下面的图像中描述你想要它找到的对象,“猫”:

来源:Meta

简而言之,SAM是用于图像检测的基础模型。

但在我们继续回答真正的问题之前,幸运的是你不必完全相信我的话,你可以使用自己的图像免费尝试这个模型:segment-anything.com/demo。

那么真正的问题是,它将如何被使用?

好的和不太好的东西

通过自主驾驶汽车,像SAM这样的计算机视觉基础模型能够对社会产生积极影响之一就是为自主驾驶提供卓越的感知能力。这些系统需要实时的无与伦比的感知能力,因为汽车必须与其环境直接交互。

随着感知能力的提高,并且经过对类似道路的环境进行微调,我们很快就会看到自主驾驶汽车在感知环境方面的增长数量级的提高,从而做出决策。

但是SAM也可以用于增强视觉障碍人士的视力,这些人可以使用这些模型更好地检测他们所看到的对象,并更好地与它们进行交互,如下图所示:

来源:Meta

另一方面,我们很容易看到这项技术如何被用于恶意活动,如大规模人群控制和社会监视。事实上,我们已经看到中国无所顾忌地监视其公民的大部分活动,因此想想这些系统的改进对中国公民意味着什么。

我们正在见证着一种将在下一代大规模监视软件背后运行的技术吗?最终的群众控制系统?

人工智能的伦理责任

与ChatGPT一样,人工智能领域的任何创新都会引发争议和伦理辩论。自然地,我们从未见过如此侵入我们生活的技术,随着这种技术能力和创新的增加,涉及隐私或安全方面的问题,以及在最广泛的意义上对我们的自由构成潜在威胁的问题都越来越多。

然而,几个世纪以来,人类的进步一直受到对增加自由的渴望的推动。

但是人工智能是可能最终扭转这种模式并成为威胁我们自己权利的技术吗?

可能已经是了。

最后一句话

虽然SAM肯定会帮助我们更好地检测对象,但它仍然没有找到如何检测人工智能机会的方法。

但如果你订阅我的通讯,你可以通过只需花费每周5分钟的时间就能了解到最终的人工智能突破。

虽然它主要是关于人工智能,但不仅如此,它还包括有关加密的主题,这是一种不可避免的技术。

译自:https://medium.com/@ignacio.de.gregorio.noblejas/meta-sam-7e48c332eff8

评论(0)